"Die größte ethische Herausforderung des 22. Jahrhunderts wird nicht sein, wie wir KI kontrollieren, sondern wie wir eine Gesellschaft gestalten, in der Menschen und KI harmonisch koexistieren und gemeinsame Werte teilen." — Prof. Elias Jansen, Ethik-Institut Berlin, 2047

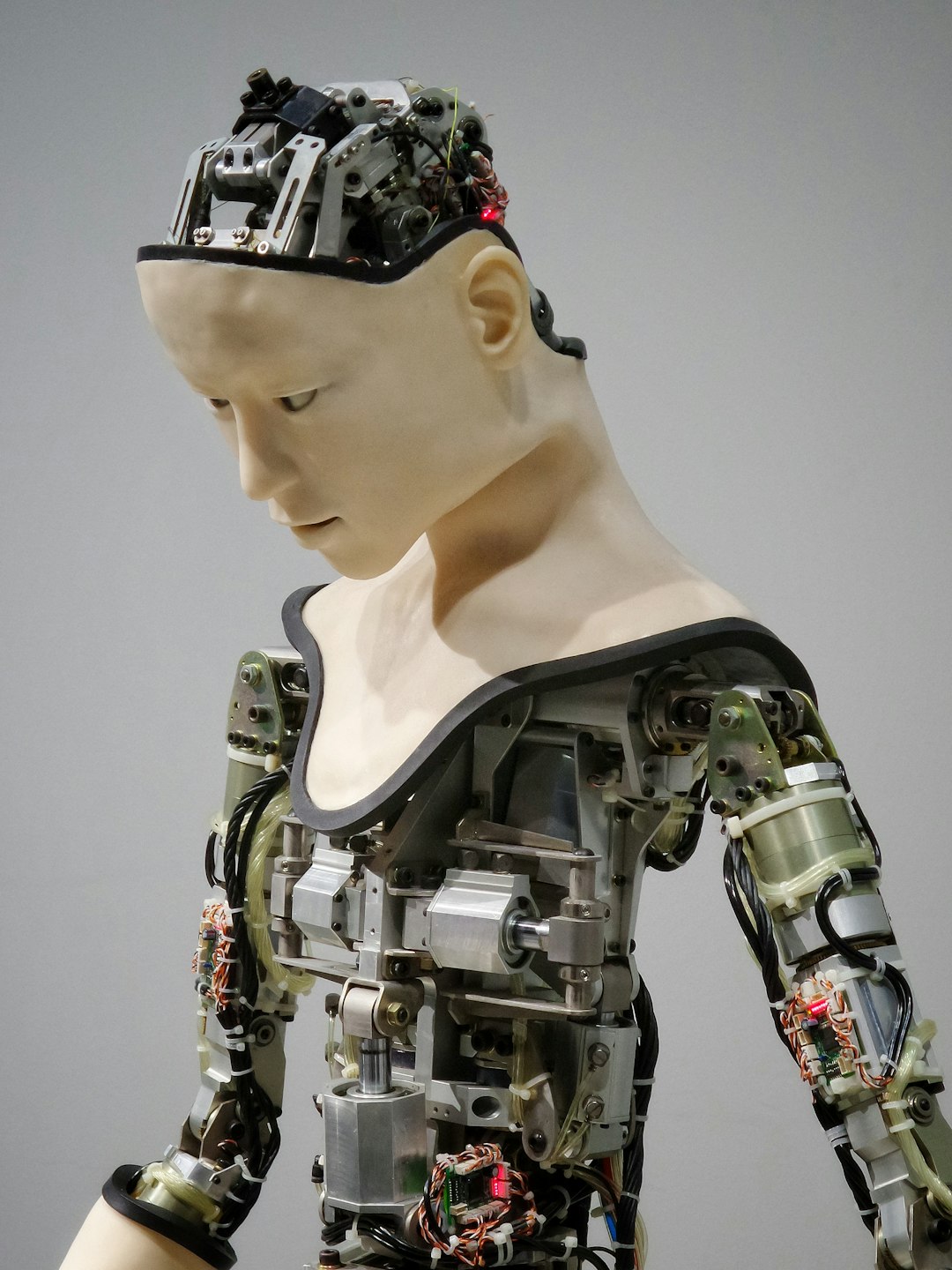

Einleitung: KI am ethischen Scheideweg

Mit der rasanten Entwicklung künstlicher Intelligenz stehen wir vor einer Vielzahl ethischer Fragen, die weit über technische Herausforderungen hinausgehen. Je mächtiger und autonomer KI-Systeme werden, desto dringlicher wird die Auseinandersetzung mit ihren moralischen Implikationen. Dieser Artikel beleuchtet die wichtigsten ethischen Herausforderungen, denen wir uns im Kontext der KI stellen müssen.

Transparenz und Erklärbarkeit: Die Black-Box-Problematik

Eine der grundlegendsten ethischen Fragen betrifft die Transparenz von KI-Entscheidungen. Komplexe Systeme wie Deep Learning-Netzwerke treffen Entscheidungen, deren genaue Logik oft selbst für ihre Entwickler undurchschaubar bleibt.

Dies führt zu mehreren Problemen:

- Wie können wir Entscheidungen vertrauen, deren Grundlage wir nicht verstehen?

- Wie lässt sich Verantwortung zuweisen, wenn Fehler auftreten?

- Wie können wir Vorurteile in Algorithmen identifizieren und beseitigen?

- Welche Standards für Transparenz sollten wir für verschiedene Anwendungsbereiche festlegen?

- Wie balancieren wir den Schutz von geistigem Eigentum mit der Notwendigkeit für Transparenz?

Die Entwicklung "erklärbarer KI" (XAI) zielt darauf ab, diese Herausforderung zu adressieren, doch die Spannung zwischen Leistungsfähigkeit und Transparenz bleibt bestehen.

Bias und Fairness: Vorurteile im Code

KI-Systeme lernen aus Daten – und diese Daten spiegeln oft gesellschaftliche Vorurteile wider. Ein KI-System zur Personalauswahl, das anhand historischer Einstellungsdaten trainiert wurde, könnte beispielsweise Diskriminierungsmuster fortführen, wenn diese in den Trainingsdaten vorhanden waren.

Zu den kritischen Fragen in diesem Bereich gehören:

- Wie erkennen und neutralisieren wir Vorurteile in Trainingsdaten?

- Welche Definition von "Fairness" sollte in verschiedenen Kontexten angewendet werden?

- Wie gehen wir mit historischen Ungerechtigkeiten um, die sich in den Daten widerspiegeln?

- Wie können wir sicherstellen, dass KI-Systeme allen Bevölkerungsgruppen gleichermaßen dienen?

- Wer trägt die Verantwortung für diskriminierende Entscheidungen einer KI?

Privatsphäre und Überwachung: Der gläserne Mensch

KI-Systeme sind besonders leistungsfähig bei der Analyse großer Datenmengen – darunter auch persönliche Informationen. Gesichtserkennung, Sprachanalyse und Verhaltensvorhersagen werfen fundamentale Fragen zum Schutz der Privatsphäre auf.

Die ethischen Herausforderungen umfassen:

- Wo liegt die Grenze zwischen nützlicher Personalisierung und invasiver Überwachung?

- Wie schützen wir die informationelle Selbstbestimmung in einer datengetriebenen Welt?

- Welche Kontrollmechanismen sollten für staatliche und kommerzielle Überwachungssysteme gelten?

- Wie gehen wir mit dem "Chilling Effect" um – der Selbstzensur aus Angst vor Überwachung?

- Welche langfristigen gesellschaftlichen Auswirkungen hat allgegenwärtige KI-gestützte Analyse?

Autonomie und Verantwortung: Wer haftet?

Mit zunehmender Autonomie von KI-Systemen – von selbstfahrenden Autos bis zu automatisierten Handelssystemen – stellt sich die Frage nach Verantwortung und Haftung für getroffene Entscheidungen.

Zentrale Dilemmata in diesem Bereich:

- Wer trägt die Verantwortung, wenn ein autonomes System einen Schaden verursacht?

- Wie programmieren wir ethische Entscheidungsregeln für Extremsituationen (z.B. unvermeidbare Unfälle)?

- Sollten KI-Systeme einen eigenen rechtlichen Status erhalten?

- Wie viel menschliche Aufsicht sollte für verschiedene Arten von KI-Entscheidungen erforderlich sein?

- Wie balancieren wir Innovation und Sicherheit bei der Regulierung autonomer Systeme?

Arbeitsmarkt und soziale Gerechtigkeit: Die Zukunft der Arbeit

KI und Automatisierung verändern die Arbeitswelt grundlegend. Während neue Berufsfelder entstehen, werden andere obsolet. Diese Transformation wirft Fragen der sozialen Gerechtigkeit und Verteilung auf.

Wichtige ethische Überlegungen:

- Wie gestalten wir einen gerechten Übergang zu einer stärker automatisierten Wirtschaft?

- Wer profitiert primär von der durch KI geschaffenen Produktivitätssteigerung?

- Welche Bildungs- und Umschulungsmaßnahmen sind notwendig?

- Sind neue Gesellschafts- und Wirtschaftsmodelle wie das bedingungslose Grundeinkommen erforderlich?

- Wie bewahren wir den Wert menschlicher Arbeit in einer Welt zunehmender Automatisierung?

KI-Governance: Wer kontrolliert die KI?

Die Konzentration von KI-Expertise und -Ressourcen bei wenigen Technologiegiganten und Großmächten führt zu Fragen der demokratischen Kontrolle und globalen Governance.

Zentrale Herausforderungen:

- Wie können wir demokratische Kontrolle über KI-Systeme sicherstellen?

- Welche internationalen Standards und Regelwerke sind notwendig?

- Wie verhindern wir ein gefährliches Wettrüsten bei KI-Militärtechnologie?

- Wie balancieren wir Innovation, Sicherheit und ethische Prinzipien?

- Wie gestalten wir eine inklusive Governance-Struktur, die diverse kulturelle Perspektiven berücksichtigt?

Fazit: Die Gestaltung unserer gemeinsamen Zukunft

Die ethischen Herausforderungen der KI sind komplex und vielschichtig. Sie erfordern einen multidisziplinären Ansatz, der technisches Verständnis mit philosophischen, soziologischen, rechtlichen und politischen Perspektiven verbindet.

Die Gestaltung ethischer KI ist keine rein technische Aufgabe, sondern ein gesellschaftlicher Prozess, der breite Beteiligung erfordert. Als Gesellschaft müssen wir entscheiden, welche Werte unsere KI-Systeme verkörpern sollen und wie wir sicherstellen, dass sie zum Wohle aller eingesetzt werden.

Letztendlich geht es nicht nur darum, was KI tun kann, sondern was sie tun sollte – und diese Frage können nur wir Menschen beantworten.